★AIDB会員限定Discordを開設いたしました!

ログインの上、マイページをご覧ください。

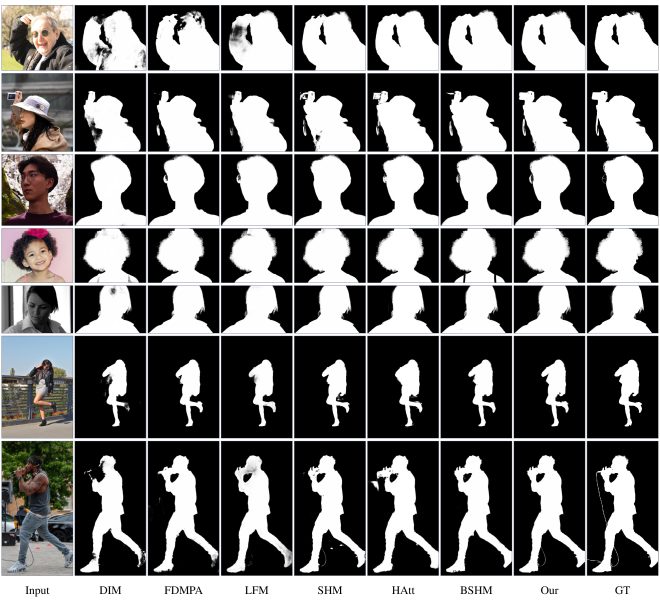

関連記事: 「背景合成」がより簡単になる。AI技術「trimapフリー」発表【CVPR2020】

グリーンバックを使用しないアルファマット予測の手法が登場しました!

背景

画像や動画から人物を抽出するためにアルファマットの予測をしますが、リアルタイムで高品質なアルファマットを得るにはグリーンバックが必要です。グリーンバックを使用しない場合、取得にコストがかかる補助入力が必要になるか、計算コストがかかる複数のモデルが必要になります。グリーンバックを使用しない既存のマット化方法は、事前に定義されたtrimap(前地/後地/未知のセグメンテーション)を使用しており、trimapは人間が注釈をつけるにはコストがかかったり、深度カメラで撮影した場合には精度が低くなったりします。そのため、最新の研究ではtrimapへのモデル依存性を排除する、trimapフリーの手法が試みられています。

SenseTimeのZhanghan Keらは、単一の入力画像からリアルタイムで人間の切り抜きを処理できる軽量のネットワークであるMODNetを提案しています。

テクノロジー

■サポートのお願い

AIDBを便利だと思っていただけた方に、任意の金額でサポートしていただけますと幸いです。

PAGE TOP

PAGE TOP