★AIDB会員限定Discordを開設いたしました!

ログインの上、マイページをご覧ください。

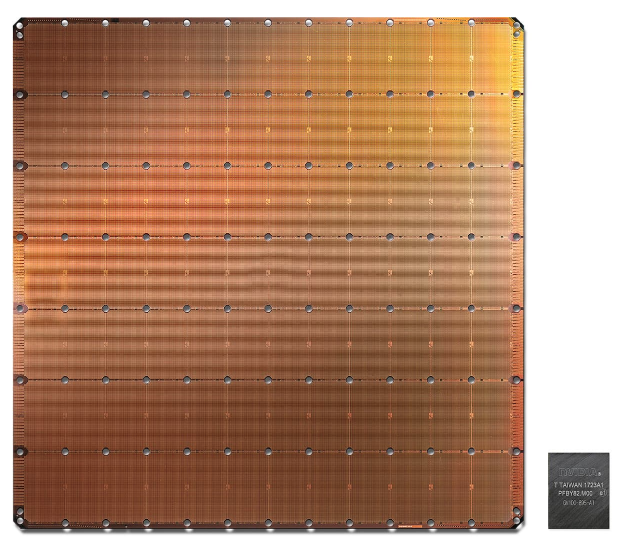

シリコンの強力なスラブは、それらのちっぽけなGPUに対応する準備ができている

Max Smolaks(寄稿者)

アメリカのスタートアップCerebras Systemsは、人工知能のワークロード用の大規模なプロセッサである最初の製品をステルスのままにしていた。

Wafer Scale Engine(WSE)は8.5 x 8.5インチの中に400,000コアを搭載し、すべてディープラーニング用に最適化され、18GBのオンチップメモリを搭載している。

「深層学習には、大規模で成長し続ける独自の計算要件がある。そして、それは基本的に他の仕事のために設計されたレガシーマシンにマッチしていない」

Cerebrasの製品管理ディレクターを務める博士アンディ・ホックは述べた。

「その結果、今日のAIはアプリケーションやアイデアではなく、コンピューティングの可用性に制約されている。単一の新しい仮説のテスト、つまり新しいモデルのトレーニングには、数日、数週間、または数か月かかることもあり、計算時間は数十万ドルにもなる。これは革新への大きな障害だ。」

■サポートのお願い

AIDBを便利だと思っていただけた方に、任意の金額でサポートしていただけますと幸いです。

PAGE TOP

PAGE TOP